Droid CLIは、BYOK(Bring Your Own Key)を通じてカスタムモデル設定をサポートしています。独自のOpenAIやAnthropicキーを使用し、任意のオープンソースモデルプロバイダーに接続するか、お使いのハードウェア上でローカルにモデルを実行できます。設定完了後は、Documentation Index

Fetch the complete documentation index at: https://docs.factory.ai/llms.txt

Use this file to discover all available pages before exploring further.

/modelコマンドを使用してモデル間を切り替えることができます。

Factory管理モデルと倍率については、利用可能なモデルを参照してください。

APIキーはローカルに保持され、Factoryサーバーにはアップロードされません。カスタムモデルはCLIでのみ利用可能で、Factory Appやモバイルプラットフォームには表示されません。

設定リファレンス

~/.factory/settings.jsonのcustomModels配列にカスタムモデルを追加してください:

レガシーサポート: 後方互換性のため、

~/.factory/config.json内でsnake_caseフィールド名(custom_models、base_urlなど)を使うカスタムモデルは引き続きサポートされます。両方のファイルが読み込まれてマージされ、settings.jsonが優先されます。apiKeyの環境変数展開はsettings.json/settings.local.jsonに適用され、レガシーのconfig.jsonには適用されません。サポートされているフィールド

| フィールド | タイプ | 必須 | 説明 |

|---|---|---|---|

model | string | ✓ | API経由で送信されるモデル識別子(例:claude-sonnet-4-5-20250929、gpt-5-codex、qwen3:4b) |

displayName | string | モデルセレクターに表示される人間が読みやすい名前 | |

baseUrl | string | ✓ | APIエンドポイントのベースURL |

apiKey | string | ✓ | プロバイダー用のAPIキー。空にはできません。settings.json/settings.local.jsonでの${VAR_NAME}をサポートします(例:${PROVIDER_API_KEY}はPROVIDER_API_KEY環境変数を使用します)。 |

provider | string | ✓ | 次のいずれか:anthropic、openai、またはgeneric-chat-completion-api |

maxOutputTokens | number | モデルレスポンスの最大出力トークン数 | |

noImageSupport | boolean | このモデルで画像入力を無効にするにはtrueに設定 | |

extraArgs | object | APIリクエストに含める追加のプロバイダー固有の引数 | |

extraHeaders | object | リクエストと共に送信する追加のHTTPヘッダー |

extraArgsの使用

temperatureやtop_pなどのプロバイダー固有のパラメータを渡します:extraHeadersの使用

APIリクエストにカスタムHTTPヘッダーを追加します:プロバイダーの理解

FactoryはAPI互換性を決定する3つのプロバイダータイプをサポートしています:| プロバイダー | API形式 | 使用目的 | ドキュメント |

|---|---|---|---|

anthropic | Anthropic Messages API (v1/messages) | 公式APIまたは互換プロキシ上のAnthropicモデル | Anthropic Messages API |

openai | OpenAI Responses API | 公式APIまたは互換プロキシ上のOpenAIモデル。GPT-5やGPT-5-Codexなどの最新モデルに必要。 | OpenAI Responses API |

generic-chat-completion-api | OpenAI Chat Completions API | OpenRouter、Fireworks、Together AI、Ollama、vLLM、およびほとんどのオープンソースプロバイダー | OpenAI Chat Completions API |

モデルサイズに関する考慮事項: 300億パラメータ未満のモデルは、エージェント型コーディングタスクで大幅に低い性能を示しています。これらの小型モデルは実験や学習には役立ちますが、本番のコーディング作業や複雑なソフトウェアエンジニアリングタスクには一般的に推奨されません。

プロンプトキャッシング

Droid CLIは利用可能な場合にプロンプトキャッシングを自動的に使用してAPIコストを削減します:- 公式プロバイダー(

anthropic、openai):Factoryは公式APIを通じてプロンプトキャッシングの使用を試みます。キャッシング動作は各プロバイダーの実装と要件に従います。 - 汎用プロバイダー(

generic-chat-completion-api):プロンプトキャッシングサポートはプロバイダーによって異なり、保証されません。一部のプロバイダーはキャッシングをサポートする場合もあれば、そうでない場合もあります。

プロンプトキャッシングの確認

カスタムモデルでプロンプトキャッシングが正しく動作しているかを確認するには:- カスタムモデルで会話を実行

- Droid CLIで

/costコマンドを使用してコスト内訳を表示 - 出力でキャッシュヒット率と節約額を確認

クイックスタート

特定の設定例を表示するには、左ナビゲーションからプロバイダーを選択してください:- Baseten - カスタムモデルのデプロイと提供

- DeepInfra - オープンソースモデル向けの費用対効果の高い推論

- Fireworks AI - オープンソースモデル向けの高性能推論

- Google Gemini - GoogleのGeminiモデルへのアクセス

- Groq - GroqのLPU™ Inference Engineによる超高速推論

- Hugging Face - HF Inference API上のモデルへの接続

- Ollama - ローカルまたはクラウドでのモデル実行

- OpenAI & Anthropic - 公式モデル用の独自APIキーの使用

- OpenRouter - 単一インターフェース経由での複数プロバイダーへのアクセス

カスタムモデルの使用

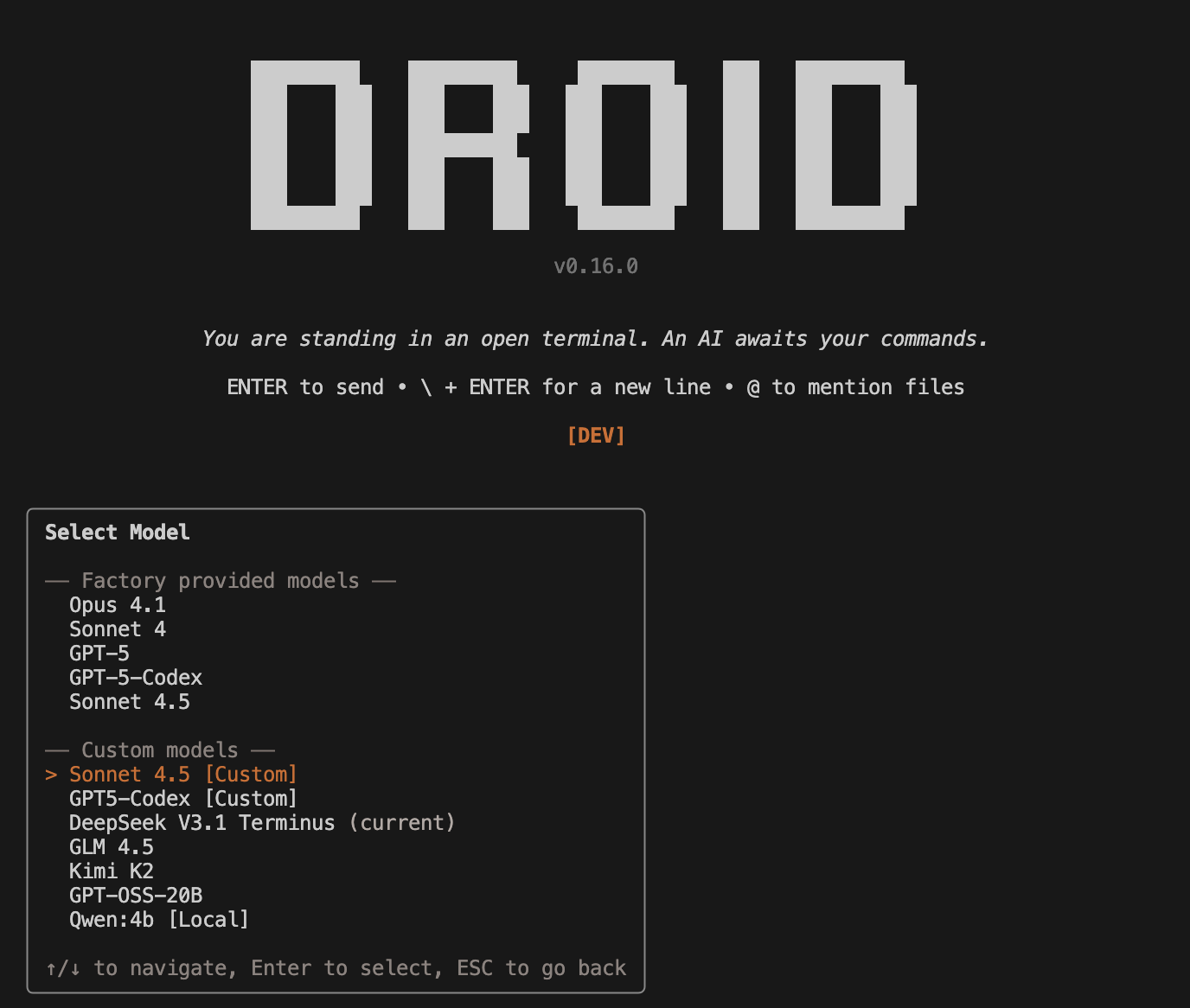

設定完了後、CLIでカスタムモデルにアクセスできます:/modelコマンドを使用- カスタムモデルはFactory提供モデルの下にある別の「カスタムモデル」セクションに表示されます

- 任意のモデルを選択して使用開始

displayNameで設定した名前で表示され、異なるプロバイダーと設定を簡単に識別できます。

トラブルシューティング

セレクターにモデルが表示されない

~/.factory/settings.json(レガシー形式を使用している場合はconfig.json)でJSON構文を確認- 設定変更はファイル監視により自動的に検出されます

- すべての必須フィールドが存在することを確認

「Invalid provider」エラー

- プロバイダーは正確に

anthropic、openai、またはgeneric-chat-completion-apiである必要があります - タイプミスを確認し、適切な大文字小文字を確保

認証エラー

- APIキーが有効で利用可能なクレジットがあることを確認

- APIキーに適切な権限があることを確認

- ベースURLがプロバイダーのドキュメントと一致することを確認

ローカルモデルが接続できない

- ローカルサーバーが実行中であることを確認(例:

ollama serve) - ベースURLが正しく、必要に応じて

/v1/サフィックスが含まれていることを確認 - モデルがローカルでプルされ/利用可能であることを確認

レート制限またはクォータエラー

- プロバイダーのレート制限と使用クォータを確認

- プロバイダーのダッシュボードで使用量を監視

請求

- Factory のマークアップや使用料なしで、プロバイダーに直接お支払いいただきます

- プロバイダーのダッシュボードでコストと使用量を追跡